大语言模型具备强大的语义理解、知识建模与生成能力,为推荐系统理解用户行为和物品语义提供了新的可能。随着大语言模型逐渐应用于推荐任务,如何让模型准确学习用户偏好,成为大模型推荐系统领域的重要问题。近年来,研究者开始将直接偏好优化(Direct Preference Optimization, DPO)等方法引入大语言模型推荐系统,通过正负样本对比,使模型学习“用户更偏好什么、不偏好什么”。在推荐场景中,用户未点击、未交互或跳过的物品天然提供了大量隐式负反馈。因此,已有研究通常认为,引入更多负样本能够提供更丰富的偏好监督信号,从而帮助模型学习更准确的用户偏好边界。

大模型推荐系统的偏好优化预期

然而,这项名为 “DynamicPO: Dynamic Preference Optimization for Recommendation”的研究发现:当负样本数量继续增加到一定规模后,推荐性能不但不再提升,反而可能出现下降;更加反直觉的是,此时训练损失仍然持续降低。针对这一现象,研究团队进一步通过实验观察和理论分析揭示了其内在原因:经过 SFT 后,模型已经具备一定粗粒度的偏好辨别能力,相当比例的随机负样本在偏好优化开始前就已经与正样本形成明显区分。随着负样本规模继续扩大,这类模型已经能够较好判别的负样本会在数量上占据主导,并在多负样本聚合优化中贡献主要梯度。它们虽然能够继续推动训练损失下降,却未必真正有助于细化用户偏好边界;相反,真正位于偏好边界附近、能够暴露模型偏好判断不足的关键负样本,其训练信号反而可能被稀释甚至压制。基于这一发现,研究团队提出 DynamicPO(Dynamic Preference Optimization) 动态偏好优化方法。该方法旨在缓解负样本规模扩大后可能出现的偏好优化坍塌:通过动态识别最接近模型决策边界、最能暴露偏好歧义的关键负样本,并针对这些边界负样本自适应调整优化强度,使模型能够在利用多负样本信息的同时,更稳定地细化用户偏好边界。

大模型推荐系统多负样本偏好优化现象及线索分析

大模型推荐系统多负样本偏好优化现象及线索分析

近日,第31届数据库系统高级应用国际会议(The 31st International Conference on Database Systems for Advanced Applications, DASFAA)在韩国济州岛召开。由上海创智学院2025级博士生胡兴宇作为第一作者兼第一通讯作者完成的研究“DynamicPO: Dynamic Preference Optimization for Recommendation” 在本届会议近 1000 篇投稿中脱颖而出,荣获 DASFAA 2026 唯一Best Paper Award(最佳论文奖)。

大语言模型推荐:从生成目标到偏好优化

大语言模型推荐:从生成目标到偏好优化

近年来,大语言模型被广泛应用于推荐系统。不同于传统推荐模型,基于大语言模型的推荐系统通常将用户历史行为、候选物品和推荐目标转化为自然语言形式,使模型以语言理解的方式完成推荐任务。在这一范式下,推荐模型通常会先通过监督微调(Supervised Fine-Tuning, SFT)适配推荐任务,使模型学会推荐任务的输入输出格式,并能够基于用户历史行为生成可能的目标物品。在此基础上,偏好优化进一步通过正样本与负样本之间的对比,引导模型显式学习“用户更偏好什么、不偏好什么”。推荐任务的核心是偏好辨别。模型不仅需要生成用户可能感兴趣的物品,还需要在大量候选物品之间形成清晰的排序边界。因此,Direct Preference Optimization(DPO)等偏好优化方法近年来被引入推荐系统,用于进一步增强大语言模型对用户偏好的刻画能力。在推荐场景中,用户未点击、未交互或被跳过的物品天然提供了大量隐式负反馈。因此,已有研究通常认为,引入更多负样本能够提供更丰富的对比监督信号,从而帮助模型学习更准确、更稳健的用户偏好边界。这也构成了多负样本偏好优化方法的重要出发点。

反直觉发现:偏好优化训练损失下降,推荐性能却退化

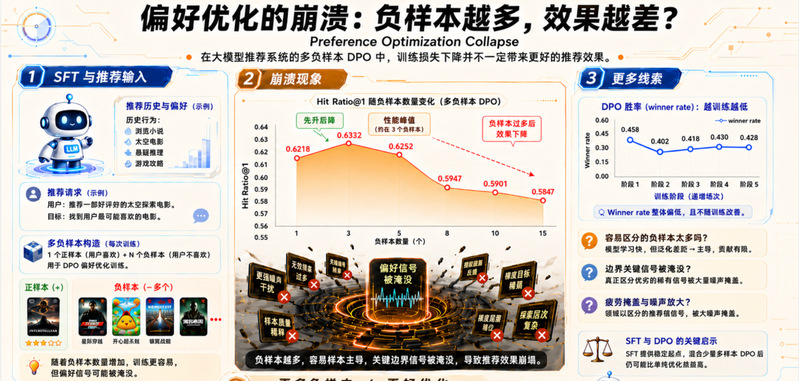

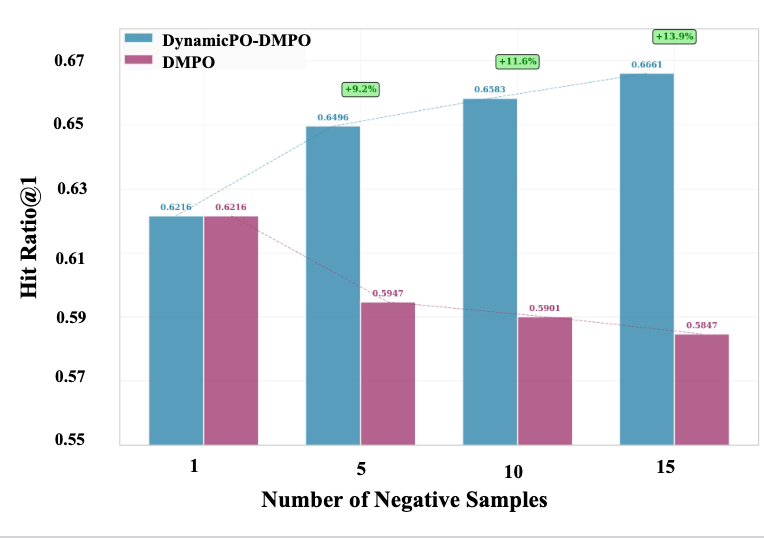

已有研究和实验表明,在一定范围内,增加负样本数量确实能够提升大语言模型推荐系统的性能。因此,多负样本偏好优化通常被认为是增强推荐模型偏好辨别能力的重要手段。但研究团队进一步提出了一个此前尚未被充分探索的问题:如果继续扩大负样本规模,这种收益是否仍然成立?

围绕这一问题,团队系统探索了更大负样本规模下的偏好优化表现。实验发现,负样本数量带来的收益并不是持续单调增长的。当负样本数量较少时,增加负样本确实能够提升推荐性能;然而,当负样本数量继续增加并超过某一临界点后,模型性能不但不再提升,反而出现明显下降。更加反直觉的是,在推荐性能下降的同时,训练损失仍然持续降低。也就是说,从优化目标来看,模型似乎仍在不断“变好”;但从真实推荐效果来看,模型却已经开始退化。

多负样本DPO的偏好优化崩塌现象

多负样本DPO的偏好优化崩塌现象

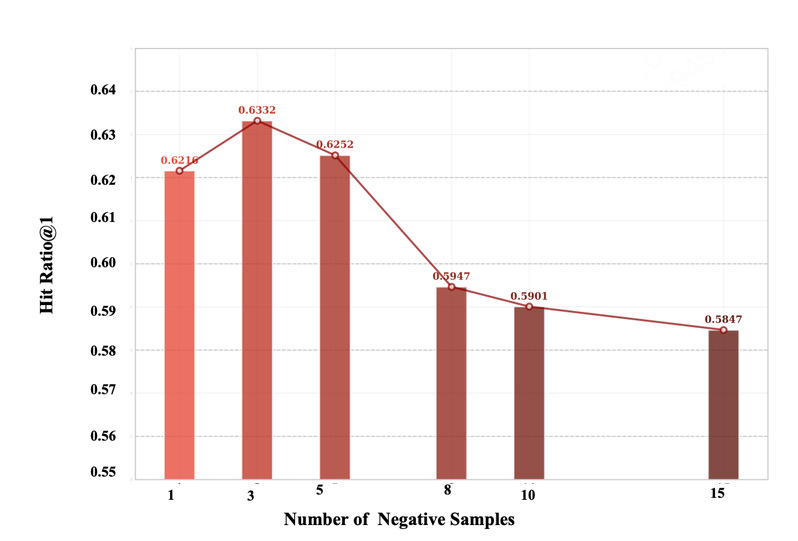

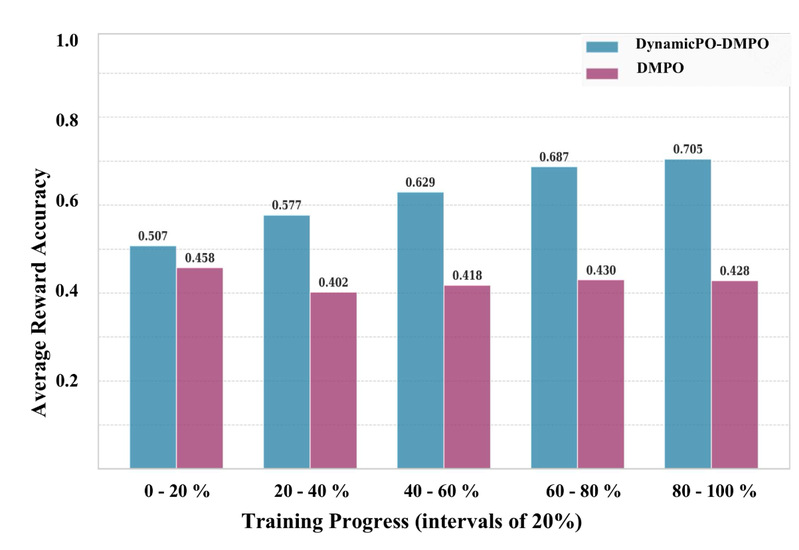

研究团队进一步追踪了训练过程中的reward winner rate,该指标衡量正样本的 reward 是否能够高于同一实例中的所有负样本,用于反映模型是否真正学到了有效的偏好排序边界。按照偏好优化的预期,winner rate 应当随着训练推进而逐步上升;但实验发现,在多负样本偏好优化中,winner rate 不但没有持续提升,反而逐渐下降。这说明模型虽然在降低训练损失,却没有真正强化正样本相对负样本的偏好优势,用户偏好边界反而可能被削弱。

多负样本偏好优化中的winner rate随训练进度的变化

多负样本偏好优化中的winner rate随训练进度的变化

研究团队将这一现象定义为 Preference Optimization Collapse(偏好优化坍塌)。这一发现说明,多负样本偏好优化的收益并非无条件成立。更多负样本虽然增加了训练信号总量,却也可能引入新的优化偏差,使模型沿着更容易降低训练损失、却未必真正提升推荐能力和偏好分辨能力的方向更新。换言之,问题并不在于“负样本有没有用”,而在于“继续增加负样本时,新增负样本是否仍然提供有效的偏好学习信号”。

从收益到坍塌:负样本规模扩大后的机制分析

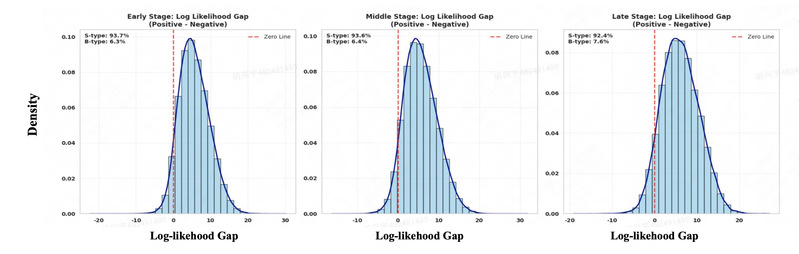

为了解释这一现象,研究团队重新审视了大语言模型推荐系统的两阶段训练过程。通常,模型会先通过 SFT 学习推荐任务的输入输出格式,并基于用户历史行为生成可能的目标物品。虽然 SFT 并不是显式的正负偏好排序训练,但它并非完全没有偏好捕捉能力。经过 SFT 后,模型已经能够从用户历史行为中学习到一定的粗粒度兴趣模式,并对明显无关的物品赋予较低似然。换言之,SFT 阶段虽然并不显式进行正负偏好排序训练,但已经使模型具备一定初步的偏好辨别能力。进入 DPO 式偏好优化后,这种能力可以通过 implicit reward 或正负样本之间的 reward gap 体现出来:对于相当比例的随机采样负样本,模型在偏好优化开始之前,就已经会赋予它们显著低于正样本的似然或 implicit reward。

基于正负样本之间的似然差距,研究团队进一步将负样本划分为两类:一类是 Model-Discriminative Negatives,即模型已经能够较好区分的负样本;另一类是 Boundary-Critical Negatives,即与正样本似然接近,甚至被模型赋予更高似然的边界负样本。研究团队在训练过程中追踪了这两类样本的比例,发现 Model-Discriminative Negatives 即使在偏好优化刚开始时也已经占据绝大多数。这表明,SFT 阶段已经使模型具备一定初步的偏好辨别能力,能够将相当比例的负样本与正样本区分开来。

SFT 后负样本信息密度不均:多数样本已被区分,少数样本决定偏好边界

SFT 后负样本信息密度不均:多数样本已被区分,少数样本决定偏好边界

然而,这也带来了新的问题:随着负样本数量继续增加,大量新增负样本往往仍是模型已经能够较好判别的容易负样本。它们虽然数量占优,却未必真正推动模型学习更细粒度的用户偏好。相比之下,真正接近偏好边界、能够暴露模型偏好判断不足的Boundary-Critical Negatives 数量较少,却对进一步优化用户偏好边界更为关键。在标准多负样本偏好优化中,所有负样本通常被统一聚合到同一个优化目标中。然而,负样本的信息密度并不均匀:部分负样本主要反映模型已经掌握的粗粒度偏好差异,而接近偏好边界的负样本才更能暴露模型尚未解决的细粒度偏好歧义。随着负样本规模扩大,优化目标可能更多受到前一类信号影响,使训练损失持续下降,却未必同步提升模型对边界样本的判别能力。因此,偏好优化坍塌并不是因为模型没有学习,而是因为模型学到了“更容易降低训练损失的方向”,却没有学到“真正提升推荐判别能力的方向”。这一分析表明,缓解偏好优化坍塌的关键并不是盲目增加负样本数量,而是识别并重点优化真正有价值的边界负样本。

DynamicPO:面向偏好边界的动态优化方法

基于上述分析,研究团队提出了 DynamicPO(Dynamic Preference Optimization)动态偏好优化方法。该方法旨在解决负样本规模扩展过程中可能出现的偏好优化坍塌问题,使模型在利用多负样本信息的同时,能够动态聚焦于真正接近偏好边界、最有助于细化用户偏好判断的关键负样本。具体而言,DynamicPO 一方面通过动态边界负样本选择机制,在线选择对模型偏好边界优化最有帮助的负样本;另一方面,通过基于双重 margin 的动态 β 调整机制,根据不同边界样本的难度自适应调节优化强度。这样,模型能够将训练重点从大量已经容易区分的负样本,转向真正影响推荐效果的边界关键样本。实验结果表明,DynamicPO 能够有效缓解偏好优化坍塌,并显著提升大语言模型推荐系统的推荐效果。同时,该方法具有轻量级、可插拔的特点,能够稳定适用于多种多负样本偏好优化目标,且几乎不增加额外计算开销。

DMPO与DynamicPO在不同负样本数量下的效果表现

DMPO与DynamicPO在不同负样本数量下的效果表现

总体而言,DynamicPO 针对多负样本偏好优化在负样本规模扩展过程中出现的偏好优化坍塌问题,提出了一种面向偏好边界的动态优化机制。该方法通过识别并强化真正影响用户偏好边界的关键负样本信号,使模型能够在充分利用多负样本监督信息的同时,避免优化过程被已分离负样本主导,从而更稳定地提升大语言模型推荐系统的偏好辨别能力。

DMPO与DynamicPO偏好优化中的winner rate对比

DMPO与DynamicPO偏好优化中的winner rate对比

此次获得 Best Paper Award,体现了国际学术界对该研究问题价值、理论洞察与方法创新性的认可。该工作揭示了大语言模型推荐系统中一个此前容易被忽视的问题:SFT 阶段已使模型具备一定粗粒度偏好判断能力,导致大量随机负样本在偏好优化开始前已被较好区分;当这些容易负样本在多负样本优化中占据主导时,真正关键的边界负样本反而可能得不到充分优化,最终引发偏好优化坍塌。围绕这一发现,DynamicPO 为多负样本偏好优化目标的设计提供了新的思路,也为构建更可靠、更高效的大语言模型推荐系统提供了重要参考。